Midjourneyで手描きっぽいイラストを動かしたい

これは、Midjourneyで作成した5秒の動画です。

Midjourneyといえば、孤高なほどに高画質で有名な画像生成AIですよね。

そのMidjourneyが2025年に入って動画も作れるようになったと聞き、期待感はかなり高まっていました。「自分好みのスタイルで、心から『いいなあ』と思えるような『絵』を生成して、それを動かしてみたい」。そんな思いで、さっそく試行錯誤を始めました。

なぜMidjourneyを選ぶのか?

元々、私はMidjourneyというツールに、開発サイドの「絵画性」への並々ならぬこだわりを感じていました。

一般的に、画像や動画を生成するAIは、ユーザーがプロンプト(指示文)などで要求するスタイル、例えば「写真のようにリアルに」とか「水彩画風で」「マンガっぽく」といった要求に対し、ツールが持っている「手持ちの札」から結果を返します。

これに対して、Midjourneyが提供してくれるスタイルの幅は、他のツールと比べても格段に広いように思うのです。単に種類が多いだけでなく、生成されるアウトプットの「センスが良い」と感じさせる何かがある。これは私にとって非常に重要なポイントです。

そんな訳で、Midjourneyは、AIで画像スタイルを探求する上で、私の満足度を最も高めてくれるツールであり続けています。

特にブラウザで直感的に操作できるWeb版が登場してからは、さらに使い勝手が向上し、「あれも試したい」「これも試したい」と、私の探求心は尽きることがありません。(クレジットが尽きるまでは…)

「自分好み」の絵を生成するために

さて、今回お見せした動画は、単にプロンプトを打ち込んでゼロからポンと生成したものではありません。そこには、いくつかのステップと試行錯誤のプロセスがありました。

まずは、そのプロセスから紹介させてください。

このサイトでは常々、たとえAIによる生成であっても、単なる「AIまかせ」ではなく、作り手自身の体験や考えに引きつけた「自分らしい表現」を追求することを提唱しています。

そこで今回、私は以前夢中になっていた「バイク乗り」としての感覚を、AIの力で再現してみることにしました。

若かりし頃、通勤で山あいの道をバイクで駆け抜けていた、あの頃の場面を数秒でも…。

イメージしたのは、手描きのドローイングにインクでさらっと彩色したような、ラフで勢いのあるスケッチ風の絵。

…のはずだったんですが、出来上がった絵を見ると、記憶の中の風景よりずいぶん立派な山の中ですし、当時の自分はここまで調子こいた(笑)感じでもなかったですね。まあ、これもAI生成の面白いところです。

最初のプロンプトと「手描き感」の課題

ご存じの通り、Midjourneyではプロンプトを英語で書く必要があります。

そこで、「スーツを着た中年男性が山道をバイクで走っている」というイメージをGoogle翻訳で英訳し、次のフレーズを入力しました。

“A middle-aged man in a suit riding a motorcycle on a mountain road”

ただ、これだけだと、おそらくMidjourneyは得意の「リアル系」や「美麗なCG系」の画像を生成してしまうでしょう。それでは、私が目指す「手描き感」とは程遠いものになってしまいます。

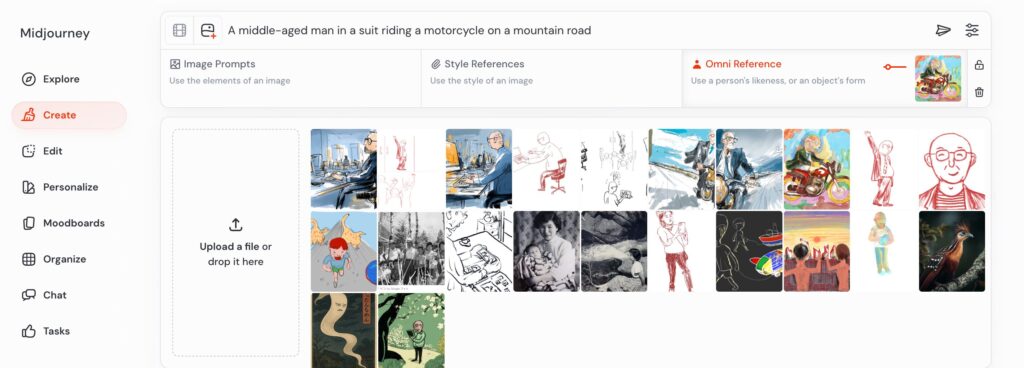

鍵となった「Omni-Reference」機能

そこで、狙った「手描き感」を演出するために、「Omni-Reference」機能を使うことにしました。

参照画像として、以前私が手描きで描いた、次のラフなイラストを配置したのです。

Omni-Referenceは、非常に強力な機能です。参照画像の「このキャラクター」や「この物体」の特徴(形、スタイル、雰囲気)を強く引き継いだまま、新しい絵の中に登場させてね、とMidjourneyに具体的に指示できる機能だと思ってください。

Web版では操作も簡単。プロンプト入力欄の左にあるアイコンから画像をアップロードし、Omni-Reference専用のスペースに画像をドラッグ&ドロップで格納します。

プロンプト周りが下の画像のようになったら、準備完了。紙飛行機アイコンを押して、生成スタートです。

Omni-Referenceの効果は…

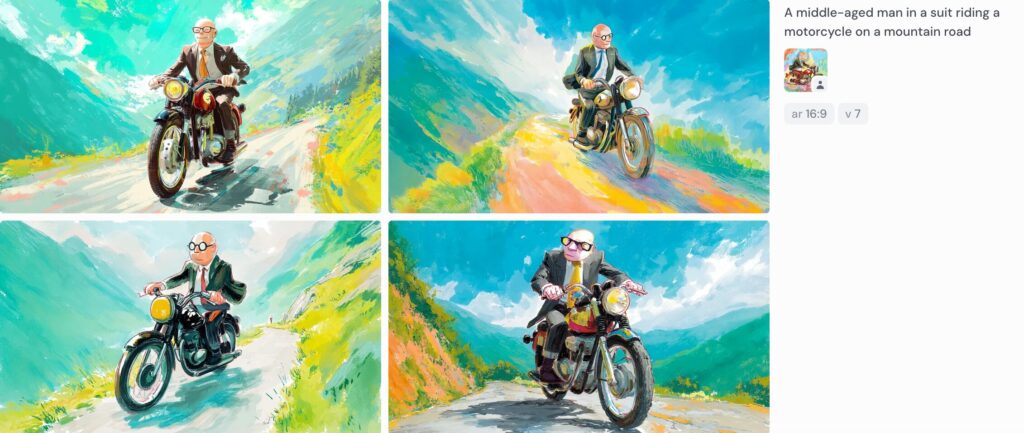

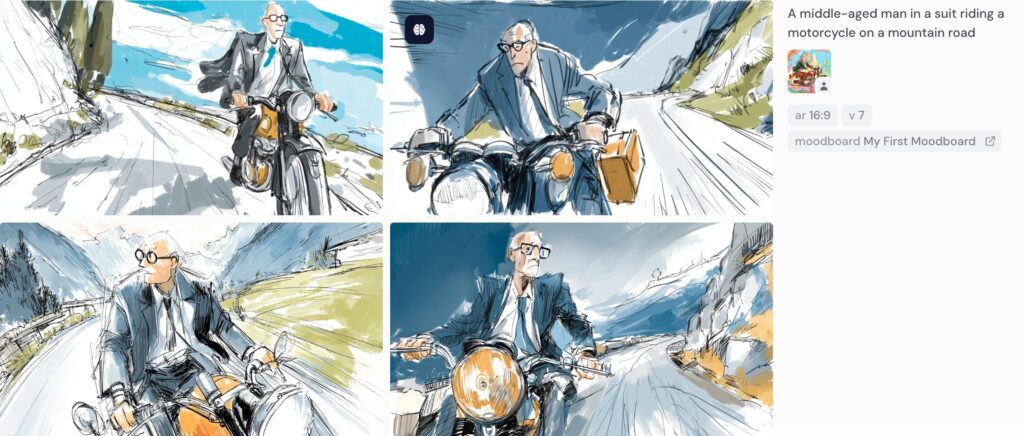

この結果、生成されたのが次の4枚です。

これはこれである意味、見事な結果が出ました。

バイクの独特な形や、ライダーのスーツにネクタイという格好、そして全体の色調(特に青の使い方)は、間違いなくOmni-Referenceに入れた参照画像を強く反映しています。

一方で、プロンプトで指示した「山道をバイクで走っている」という要素によって、参照画像では抽象的だった背景が、具体的な「山道」という風景に置き換わっています。

参照画像のスタイルと、プロンプトの指示が見事に融合したわけです。

ですが、肝心の「インクスケッチ感」は、残念ながらありません。

まあ、元の参照画像がそこまでインクスケッチ感が強いわけではないので、当然といえば当然の結果かもしれません。

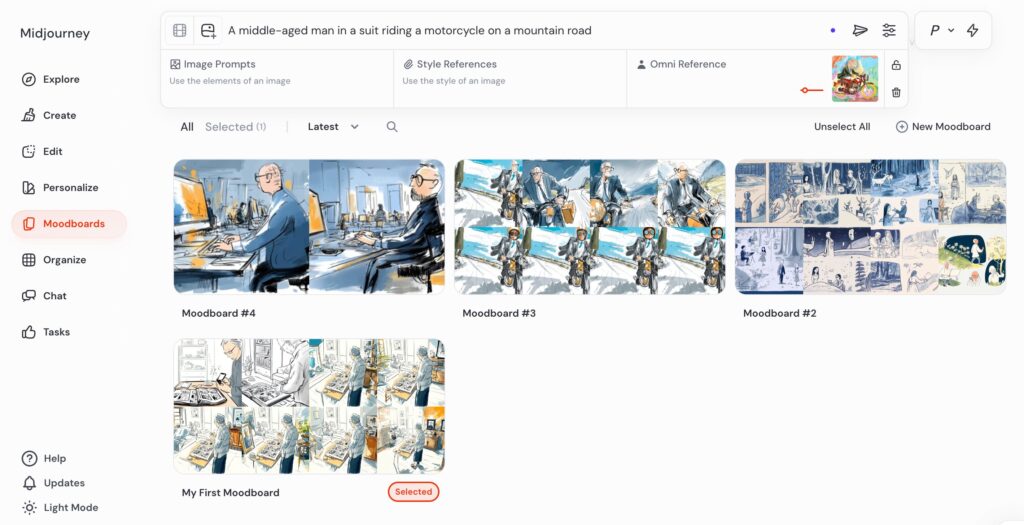

次なる一手「ムードボード(moodboard)」を使う

そこで、今度は「ムードボード(moodboard)」という別の機能を使って、画像の「テイスト」や「方向性」をより強く指定してみることにしました。

Midjourneyにおける「moodboard」とは、一言でいえば「“自分の美意識”をAIに学習させるための、パーソナライズ用スタイル集」です。複数の参照画像(=お手本)を集めてボードを作ることで、「こういう雰囲気でよろしく!」とAIに指示できます。似た機能に「Style Reference」がありますが、ムードボードは、色合い、質感、構図、全体のムード(雰囲気)といった、より幅広く曖昧な「好み」を一括で反映できるのが特徴です。

Web版の左メニューから「Moodboards」を選ぶと、右側にこれまで作成したムードボード集が表示されます。

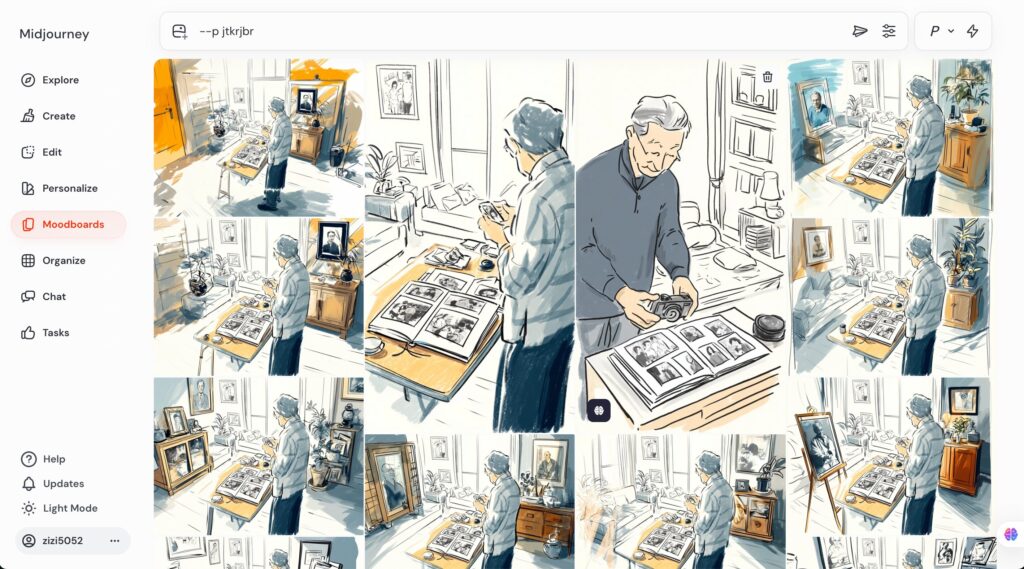

今回は、下のスクリーンショットで分かるように、以前「室内で男性が作業をしている」シーンを集めて作成した、インクスケッチ風のムードボードを選んでみました。(選ぶと「Selected」と赤字で表示されます)

ちなみに、選んだムードボードを開くとこんな感じです。この「雰囲気」を拝借しようというわけですね。

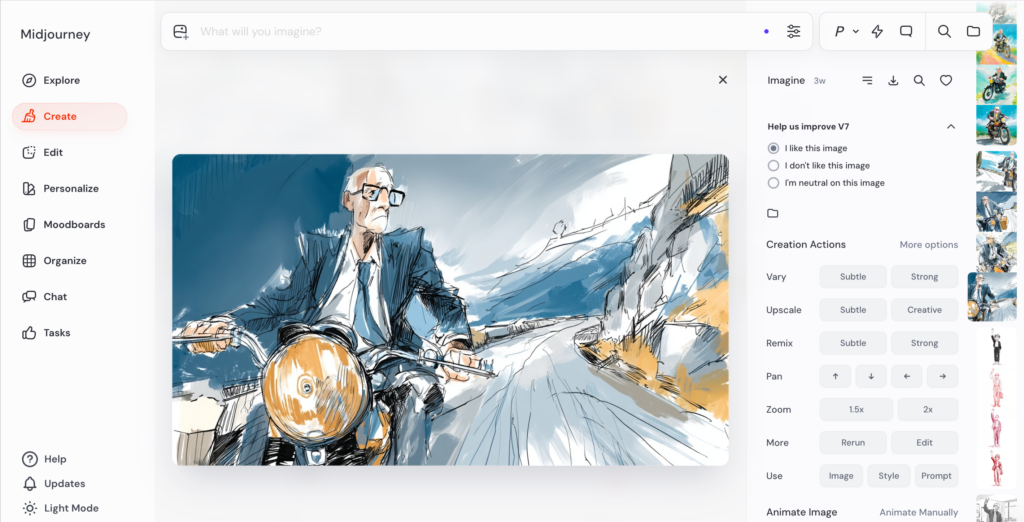

Omni-Reference(バイクの絵)と、ムードボード(インクスケッチ風)を両方組み合わせて生成した結果が、次の4枚です。

狙い通り、インクで描いたような、雰囲気のある絵のスタイルになりました!

しかし、ここでまた新たな問題が。

「絵のスタイルはこれでいい。でも、ライダーのキャラクターが、私のイメージと全然違う…。」

「Edit」機能で、こだわりを追求する(部分修正)

ここからがMidjourney Web版の真骨頂です。

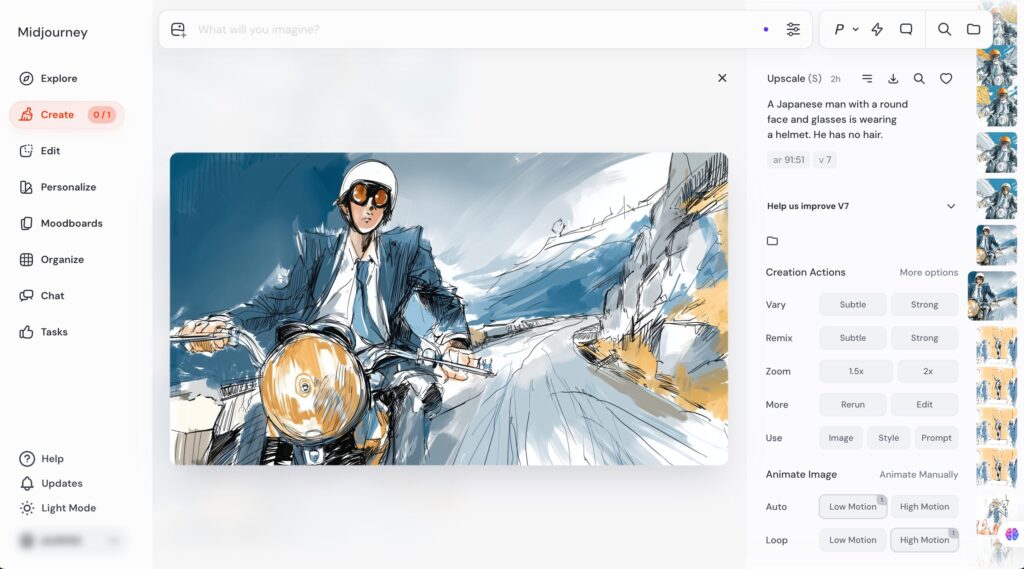

ベースにしたい一枚を選んでダブルクリックすると、画像が拡大表示されると同時に、編集機能が表示されます。ここで「Edit」ボタンを押します。

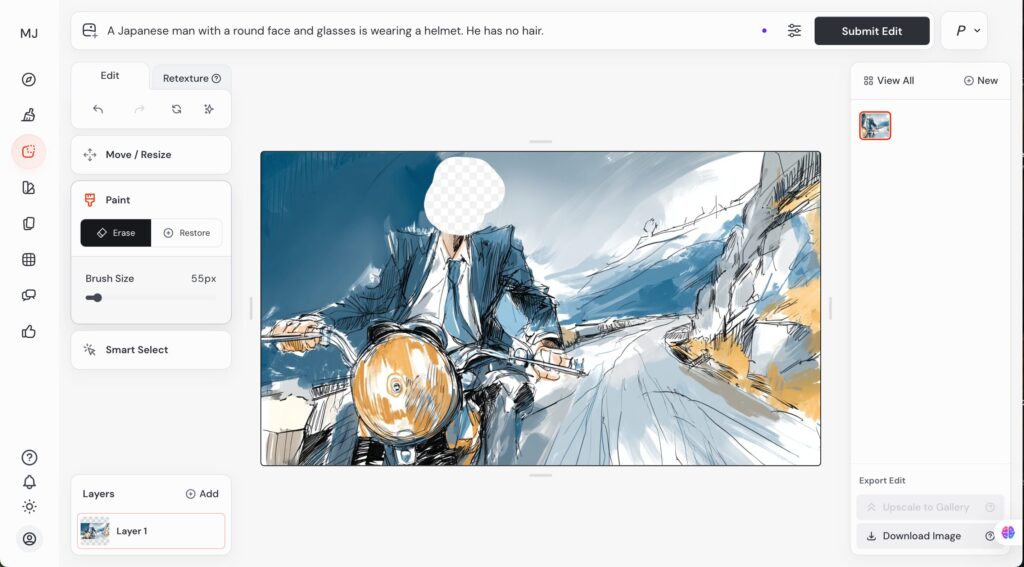

Editモードに入ると、左側にPaint(塗りつぶし)ツールが現れます。

これで、変更したい場所(今回は顔とヘルメット周り)を大雑把に塗りつぶします。

そして、その下にあるプロンプト欄に、「どのように変更したいか」を具体的に書き込みます。

今回は、当時の自分に近づけるため、「丸顔で眼鏡をかけた日本人男性がヘルメットをかぶっています。髪はありません。」という、かなり具体的な指示を入れました。(英訳:”A Japanese man with a round face and glasses is wearing a helmet. He has no hair.”)

「髪はありません。」というのは、当時私が短髪(というか、ほぼ坊主)だったためです。

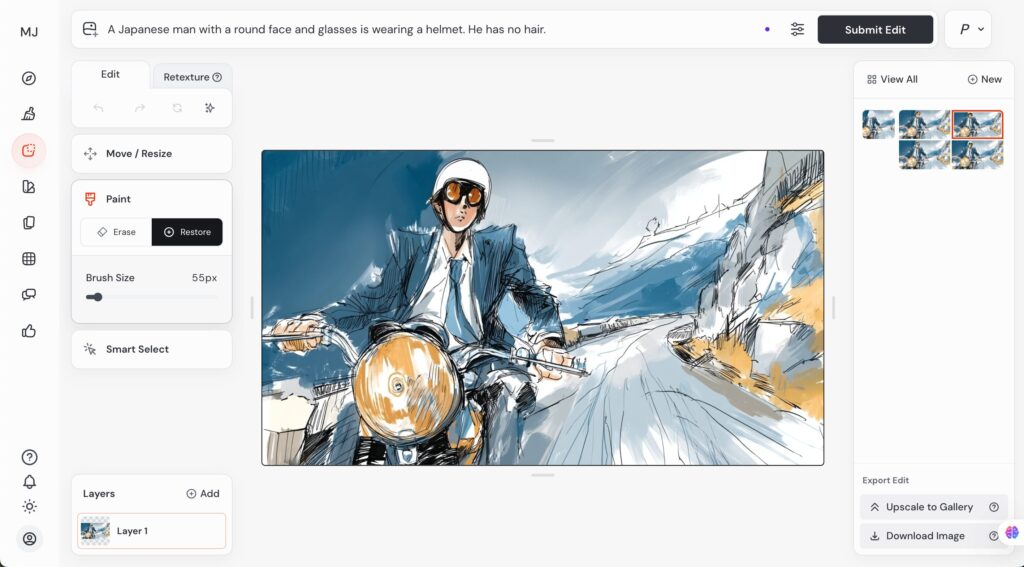

「Submit Edit」を押すと、Midjourneyは指定された部分だけを、新しいプロンプトに従って再描画してくれます。

変更結果は、また4パターン作成されます。右側に並んだサムネイルから、一番イメージに近いものを選べるわけです。

こうして、全体のスタイルは保ったまま、キャラクターの顔だけを自分のイメージに近づけることができました。

ついに「動かす」

さあ、いよいよ最終目的の「動画化」です。

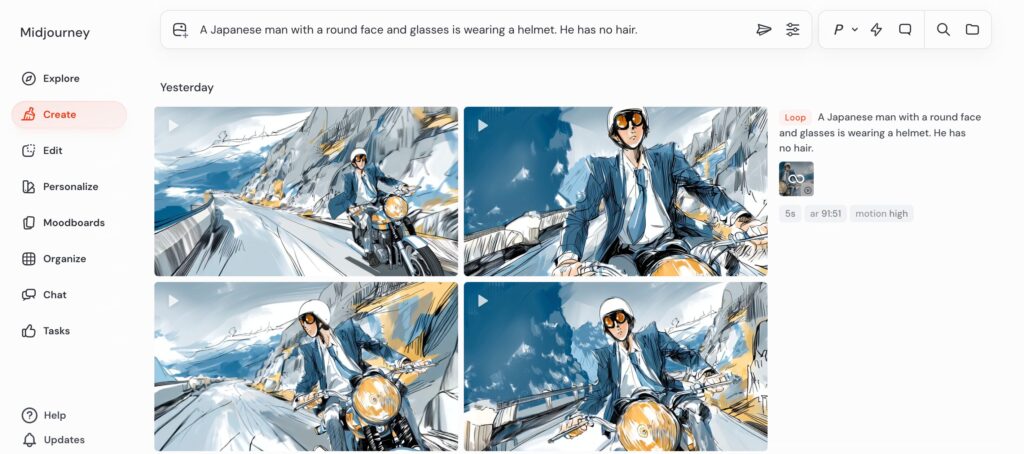

今回は、バイクが走っているシーンなので、同じ動きを繰り返す「ループ」になる動きが見たいと考えました。

画像の編集画面(または拡大表示画面)にある「Animate」セクションに注目します。

ここで、「Loop」(ループ再生)をオンにし、動きの度合いとして「High Motion」(動きを大きく)ボタンを押しました。

すると、Midjourneyがこの静止画をベースに、動きを解釈して生成を始めます。

このように、5秒間の動画が4パターン生成されます。

ループ動画として生成されているため、右側のサムネイルには「無限大(∞)」マークがついています。

こうして、手描きのインクスケッチ風イラストが、まるで命を吹き込まれたかのように動き出す、5秒間の作品が完成しました。

補足

動画につけたエンジン音と風が吹いてる音は、ElevenLabsで作成して、LumaFusionで組み合わせました。

あれ?今気づいたけど、ここまで全部iPadでもできるんじゃない!?

最後までお読みいただき、ありがとうございました。